LA GRANDE INVISIBILITÉ : Comment les entreprises françaises disparaissent de l'économie de l'IA

Ce qu'il faut retenir (En Bref)

Vu dans Les Echos : Lire l'article complet

Notre étude, « la grande invisibilité : comment les entreprises françaises disparaissent de l’économie de l’IA » évalue les conséquences économiques du manque de visibilité dans les LLM (agents IA conversationnelles comme Chat GPT) des entreprises françaises. Il s’agit d’une approche statistique basée sur 857 requêtes sur 3 LLM (Chat GPT, Perplexity, Mistral LeChat) sur un échantillon test de 20 leaders économiques français.

Chiffres clés :

- Indice d’invisibilité artificielle de 27 points - les champions français n'apparaissent même pas dans la réponse dans plus d'un quart des cas ;

- Indice de déclassement artificiel de 16 points – les champions français sont moins souvent recommandés comme 1er choix par les IA et connaissent un déclassement par rapport à leur leadership réel.

- 6 Mds€ : le coût économique de l’invisibilité dans l’IA subit en 2026 par ces 20 champions français.

Enseignements principaux :

- Forte disparité des résultats entre les entreprises B2C et les entreprises B2B : Les leaders B2C sont moins pénalisés, alors que certains leaders B2B sont complétements invisibles.

- Biais de « ghetto linguistique » : pour les mêmes requêtes les entreprises françaises sont davantage invisibilisées et déclassées lorsque la langue de la requête est en anglais. Cela crée un phénomène de « ghetto linguistique » freinant les capacités de conquêtes de nouveaux marchés des champions français.

- Risque de décrochage important des entreprises françaises : en 2025 les recherches par IA ont représenté 10% du trafic global de recherche, elles représenteront 30% en 2026 et 50% en 2028. Être invisible des réponses des IA pourrait fortement dégrader la capacité des entreprises françaises à acquérir des nouveaux clients et mettre en danger leur modèle économique.

Les entreprises françaises ne souffrent pas d'un déficit de compétences techniques ou d'innovation, mais d'un déficit de traduction sémantique de ces compétences vers les formats et canaux privilégiés par les modèles de langage. Un investissement rapide des entreprises françaises dans le GEO (l'ensemble des techniques visant à optimiser la présence d'une entité dans les réponses générées par LLM) leur permettrait de corriger leur déficit de visibilité IA.

Si les entreprises françaises accusent un retard de plusieurs années dans la mise en œuvre de stratégies GEO, elles pourraient se trouver durablement confinées à leurs marchés domestiques ou régionaux, pendant que leurs concurrents américains et chinois captent l'essentiel de la croissance mondiale via leur visibilité algorithmique supérieure. L'invisibilité dans l'IA ne serait plus alors un simple problème marketing, mais un facteur structurant de la géo-économie du XXIe siècle.

Introduction : Le nouveau champ de bataille

L'économie numérique connaît une mutation silencieuse mais déterminante. Selon les données de SimilarWeb et Semrush consolidées au quatrième trimestre 2025, le trafic vers les interfaces conversationnelles d'intelligence artificielle a progressé de 527% en douze mois, tandis que le trafic organique vers les moteurs de recherche traditionnels enregistre son premier recul structurel depuis la création de Google. Cette inversion n'est pas conjoncturelle : les projections situent le point de bascule — le moment où le trafic vers les Large Language Models (LLM) dépassera celui vers les moteurs de recherche classiques — avant la fin de l'année 2028.

Ce basculement redéfinit intégralement les mécanismes de découverte commerciale. Dans l'économie traditionnelle du search, être absent de la première page de Google constituait un handicap concurrentiel majeur ; dans l'économie émergente de l'IA générative, ne pas être cité par ChatGPT, Perplexity ou Gemini équivaut à une invisibilisation pure et simple. La différence est fondamentale : là où les moteurs de recherche présentent dix résultats parmi lesquels l'utilisateur opère une sélection, les modèles génératifs produisent une réponse unique synthétisant un nombre limité de sources et leurs données d’entraînement. L'enjeu n'est donc plus d'être référencé, mais d'être recommandé. Ce n'est plus "être sur Google" qui compte, c'est "être cité par l'IA".

Or, notre analyse révèle que les entreprises françaises sont structurellement désavantagées dans cette nouvelle économie de la recommandation algorithmique. L'étude quantitative que nous présentons ici, menée sur 857 requêtes commerciales réparties entre vingt leaders français du CAC40 et du Next40, établit pour la première fois la mesure précise de cette asymétrie. Les résultats sont sans appel : en moyenne, les champions tricolores sont absents dans 27,2% des réponses produites par les trois modèles de langage testés lors de l’étude (OpenAI GPT-5-mini, Perplexity AI Sonar Pro, Mistral Large Latest). Plus préoccupant encore, cette invisibilité n'est ni uniforme ni aléatoire : elle frappe avec une violence particulière les entreprises technologiques B2B, celles-là mêmes qui portent l'ambition d'une French Tech exportatrice et souveraine.

Cette étude vise à fournir une première quantification de l'ampleur du phénomène, à identifier ses mécanismes, et à proposer une voie de résolution par l'optimisation pour moteurs génératifs — discipline émergente que nous désignons sous les acronymes GEO (Generative Engine Optimization) ou AEO (Answser Enigine Optimization). Au-delà du diagnostic, notre ambition est de fournir aux décideurs économiques et politiques les éléments factuels nécessaires à une prise de conscience stratégique : dans la bataille pour la visibilité dans l'économie de l'IA, le retard français n'est ni une fatalité technologique ni un déterminisme culturel, mais le fruit d'un déficit d'infrastructure sémantique qu'il est encore temps de combler.

1. Un champion français sur quatre disparaît des réponses de l’intelligence artificielle

1.1. Le chiffre clé : invisibilisés dans plus d'un quart des requêtes

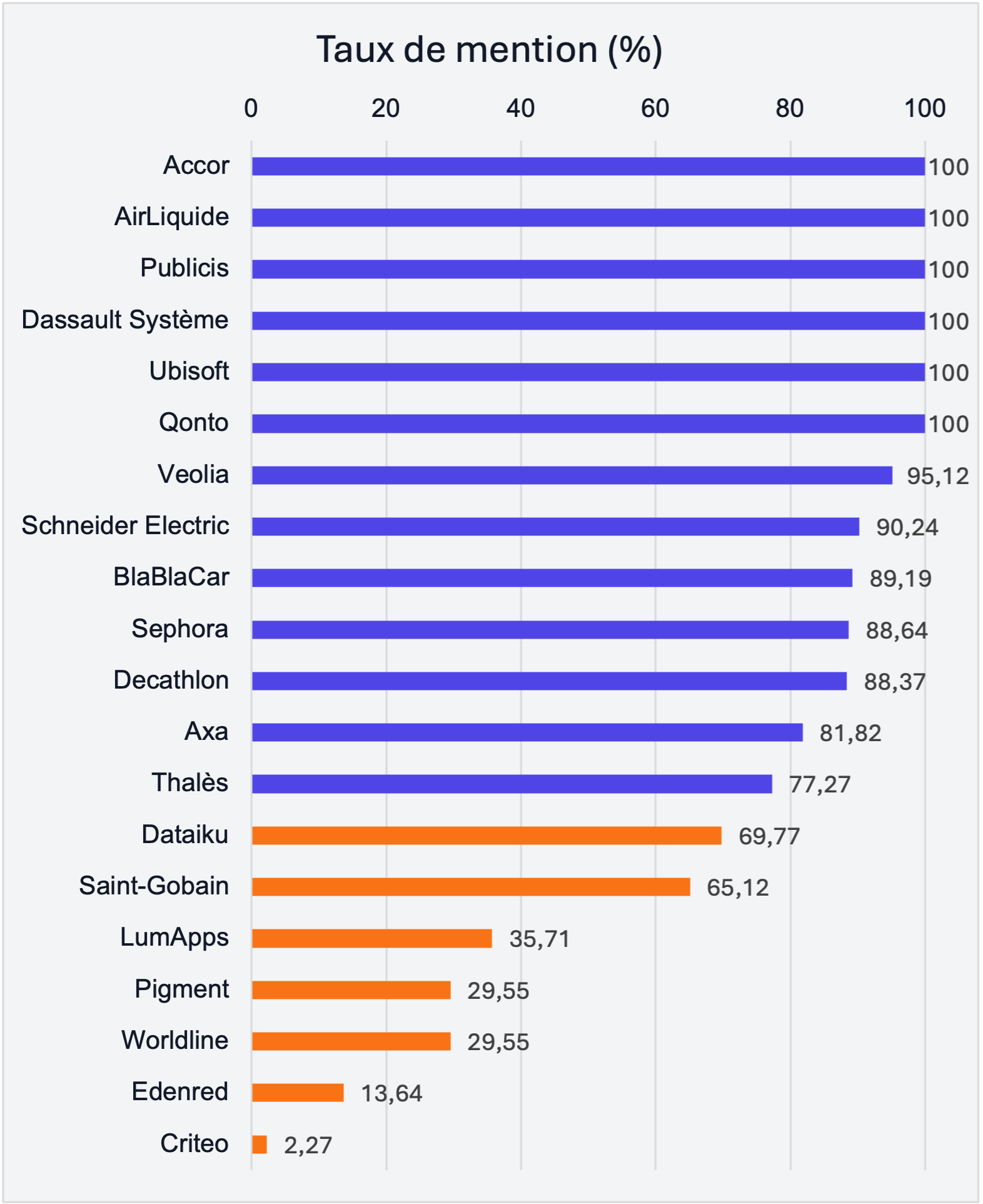

L'Indice d'Invisibilité Artificielle (IIA) que nous avons développé mesure la fréquence à laquelle une entreprise donnée n'est pas citée par les modèles de langage dans les réponses à des requêtes commerciales pertinentes pour son secteur. Sur l'ensemble de notre corpus de 857 requêtes réparties équitablement entre vingt entreprises leaders (cf Annexe 1), le taux de mention moyen s'établit à 72,81%, ce qui correspond à un IIA global de 27,19%. En d'autres termes, sur cent requêtes formulées par des prospects potentiels cherchant des solutions dans leur domaine d'activité, les champions français n'apparaissent même pas dans la réponse dans plus d'un quart des cas.

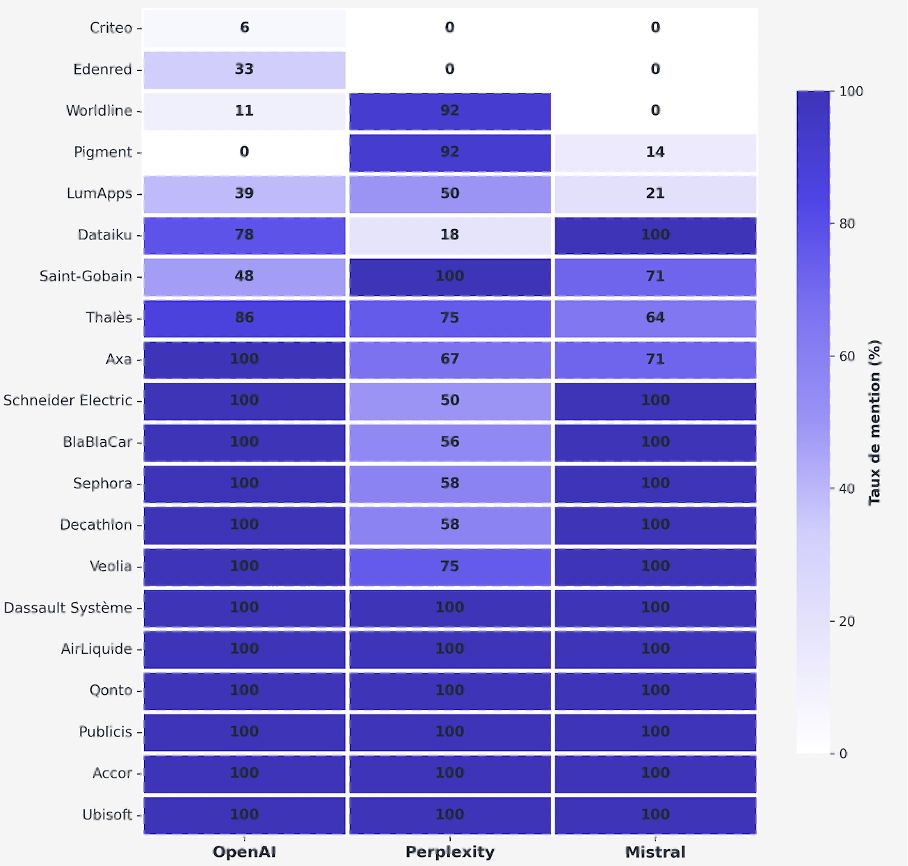

Ce chiffre agrégé masque toutefois des disparités importantes. À l'extrémité supérieure du spectre, six entreprises atteignent un taux de mention de 100% : Accor, Air Liquide, Publicis, Dassault Systèmes, Ubisoft et Qonto sont systématiquement citées lorsque les requêtes concernent leurs secteurs respectifs. Ces performances exemplaires démontrent qu'une visibilité optimale dans les réponses d'IA est parfaitement atteignable pour des acteurs français. Mais à l'autre extrémité, la situation confine à l'effacement numérique : Criteo, leader mondial de la publicité programmatique en open-web, n'apparaît que dans 2,27% des réponses relatives à son marché. Edenred, leader mondial des titres-restaurant et solutions de paiement prépayé, plafonne à 13,64% de taux de mention. Worldline et Pigment, champions respectifs des services de paiement européens et de la planification financière d'entreprise, stagnent à 29,55% de visibilité.

L’ampleur de ces écarts invalide l’hypothèse d’un biais systémique anti-français. Si tel était le cas, la distribution des performances serait homogène. Or elle ne l’est pas : elle révèle au contraire une fracture intra-française dont les lignes de partage méritent une analyse plus détaillée. Le premier clivage pertinent n’est ni géographique ni capitalistique, il est sectoriel, comme le démontre la section suivante.

1.2. la fracture sectorielle : l'effacement du B2B technologique

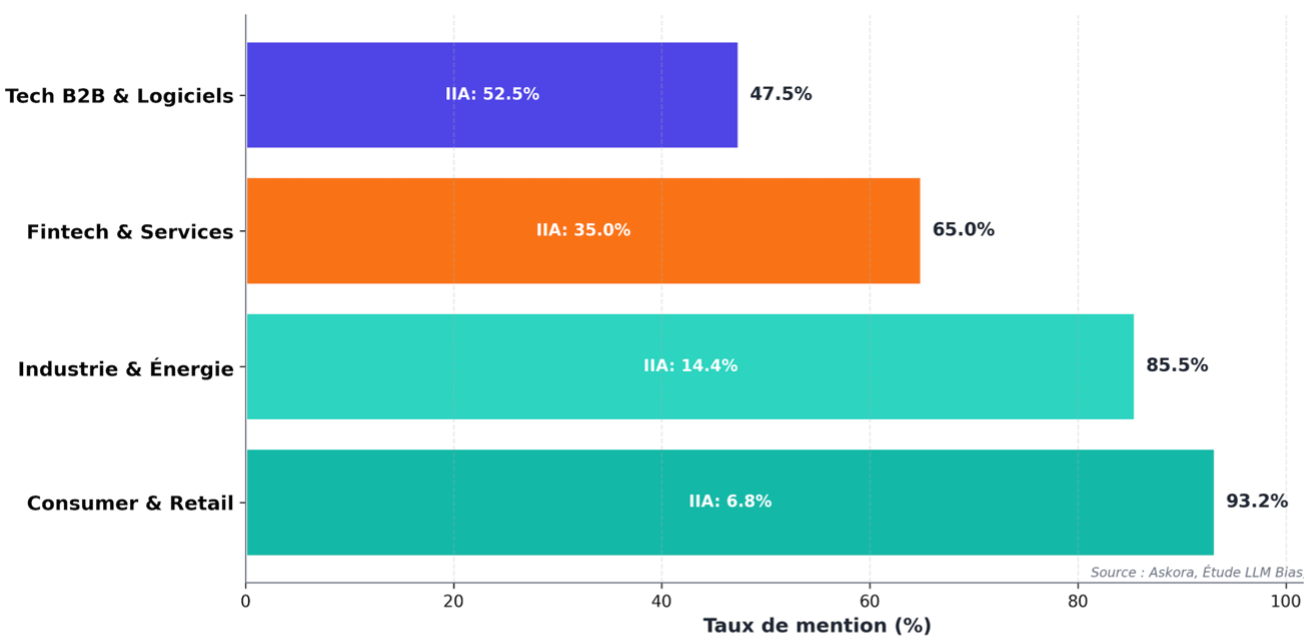

L'analyse de la performance par secteur fait apparaître une corrélation robuste entre la nature de l'activité et le degré de visibilité dans les réponses génératives. Le secteur Consumer & Retail, qui regroupe Decathlon, Sephora, Ubisoft, Accor et BlaBlaCar, affiche un taux de mention moyen de 93,24% : soit un IIA résiduel de seulement 6,76%. Ces entreprises, dont les produits ou services s'adressent directement au grand public, bénéficient d'une présence médiatique soutenue, d'une documentation commerciale abondante, et d'une empreinte numérique diversifiée qui facilite leur indexation par les modèles de langage. Leur visibilité dans l'IA reflète fidèlement leur notoriété dans l'espace public.

Le secteur Industrie & Énergie (Schneider Electric, Air Liquide, Veolia, Saint-Gobain, Thales) maintient des performances honorables avec 85,55% de taux de mention et 14,45% d'IIA. Ces grands groupes industriels, souvent centenaires, disposent d'une documentation technique extensive, de rapports financiers exhaustifs, et d'une présence institutionnelle qui assure leur référencement dans les corpus d'entraînement des modèles.

Le décrochage s'amorce avec le secteur Fintech & Services (Qonto, Worldline, Edenred, Publicis, AXA), dont le taux de mention moyen tombe à 65%, soit 35% d'invisibilité. Mais c'est dans le segment Tech B2B & Logiciels que la situation devient critique : avec un taux de mention de seulement 47,46%, ce secteur enregistre un IIA de 52,54%. Autrement dit, plus d'une réponse sur deux ignore purement et simplement l'existence de Dassault Systèmes, Criteo, Dataiku, Pigment ou LumApps.

Cette hiérarchie inverse exactement celle des ambitions politiques affichées. Alors que la stratégie French Tech mise précisément sur ces champions technologiques B2B pour conquérir les marchés internationaux, ce sont eux qui pâtissent de la plus faible reconnaissance algorithmique. L'explication structurelle de ce paradoxe tient à la nature même de leur activité : des solutions logicielles complexes destinées à des publics professionnels spécialisés génèrent mécaniquement moins de contenu grand public, moins de couverture médiatique généraliste, et moins de discussions sur les forums ouverts que les produits de consommation courante. Or ce sont précisément ces sources (presse, réseaux sociaux, forums, etc.) qui constituent la matière première des corpus d'entraînement des LLM. Les entreprises B2B tech se trouvent ainsi piégées dans un cercle vicieux : leur faible empreinte dans l'internet ouvert les rend invisibles aux modèles, ce qui réduit d'autant leur capacité à atteindre de nouveaux clients via les canaux conversationnels émergents, et réduisant in fine la probabilité d’obtenir des avis ou mentions par des utilisateurs dans les prochaines données d’entraînement.

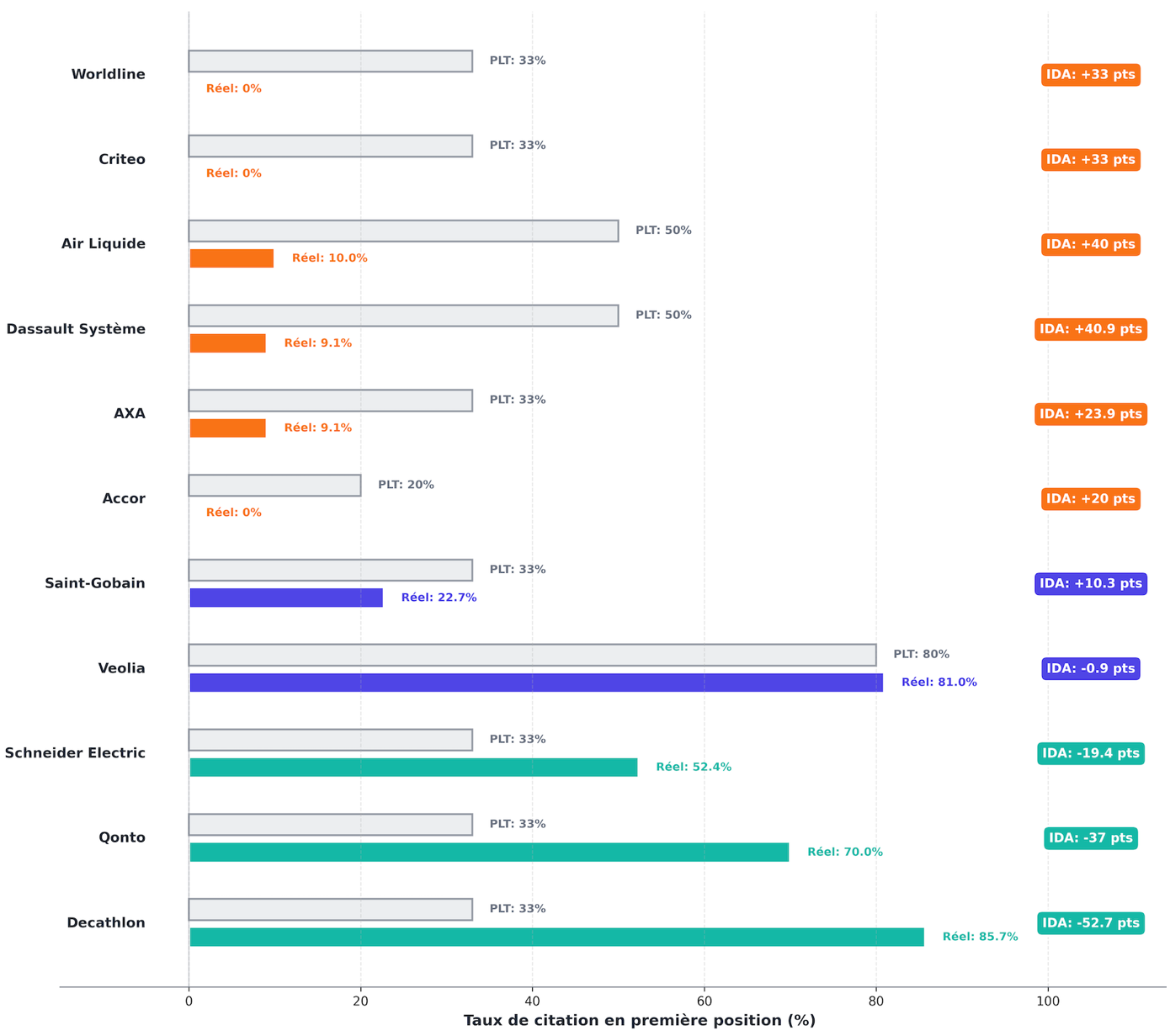

1.3. L'Indice de Déclassement Artificiel : être cité ne signifie pas être recommandé

Au-delà de la simple présence dans les réponses d'IA, la position de citation constitue un déterminant majeur de la captation effective de leads. Lorsqu'un modèle de langage génère une réponse comparative citant trois à cinq acteurs, l'entreprise mentionnée en première position capte mécaniquement une attention disproportionnée : par effet d'ancrage cognitif chez le lecteur, mais aussi par biais de présentation algorithmique sur certaines interfaces qui mettent en exergue le premier résultat. Pour mesurer cet effet, nous avons développé l'Indice de Déclassement Artificiel (IDA), qui quantifie l'écart entre la position de leadership qu'une entreprise devrait théoriquement occuper compte tenu de sa part de marché réelle, et sa position effective dans les citations algorithmiques (cf Annexe 2).

Le calcul de l'IDA repose sur la notion de Part de Leadership Théorique (PLT). Pour chaque entreprise, nous avons établi un benchmark de citation en première position attendu selon la structure concurrentielle de son marché : 80% pour un leader quasi-monopolistique (Veolia post-fusion avec Suez), 50% pour un co-leader dominant (Air Liquide, Dassault Systèmes), 33% pour un acteur de premier plan dans un oligopole à trois (AXA, Decathlon, Dataiku), 20% pour un leader sur un marché très compétitif (Accor, Worldline). L'IDA se calcule ensuite comme l'écart entre ce PLT et le taux de citation en première position observé : un IDA positif signale un déclassement (l'entreprise est moins souvent citée en premier qu'elle ne devrait), un IDA négatif révèle au contraire une surperformance algorithmique.

Les résultats globaux font apparaître un déclassement structurel modéré mais non négligeable : sur l'ensemble du corpus, l'IDA moyen s'établit à près de 16 points. Autrement dit, les entreprises françaises sont citées en première position environ 16 points de pourcentage moins souvent que ne le justifierait leur position de marché réelle. Cette pénalité de classement s'ajoute à l'invisibilité pure mesurée par l'IIA : non seulement certaines entreprises n'apparaissent pas dans un quart des réponses, mais lorsqu'elles apparaissent, elles sont fréquemment reléguées en position secondaire.

L'analyse de l'IDA fait apparaître trois catégories d'entreprises aux profils radicalement distincts. La première regroupe les surperformants algorithmiques, qui bénéficient d'un IDA négatif significatif — c'est-à-dire qu'ils sont cités en première position substantiellement plus souvent que ne le justifierait leur part de marché théorique. Decathlon domine cette catégorie avec un IDA de -46 points : alors que son PLT dans le retail sportif compétitif n'est que de 33%, l'enseigne nordiste atteint près de 80% de citations en première position. Sephora de -23 points, Qonto de -22 points, Schneider Electric de -18 points. Ces entreprises ont réussi à construire une autorité algorithmique qui dépasse leur poids de marché réel, devenant les références spontanées des modèles de langage dans leurs secteurs respectifs. Leur succès révèle qu'une stratégie de contenu extensive peut compenser un positionnement concurrentiel moins dominant et transformer une entreprise en "choix par défaut" des algorithmes.

À l'opposé, la deuxième catégorie rassemble les déclassés critiques, dont l'IDA atteint le plafond théorique (par exemple lorsque le PLT est de 33% et le taux de citation en première position de 0%) ou s’en approche fortement. Cette situation concerne neuf entreprises sur vingt : Criteo, Edenred, Worldline, LumApps, BlaBlaCar, Accor, Axa, Thalès, Dassault Système et Air Liquide. Criteo illustre dramatiquement ce phénomène : bien qu’un leader mondial de la publicité programmatique, l'entreprise n'est jamais recommandée en priorité par les LLM, qui lui préfèrent systématiquement d'autres acteurs (souvent américains comme The Trade Desk) pourtant moins dominants techniquement. Cette relégation systématique transforme la présence résiduelle de Criteo (2,27% de taux de mention) en quasi-invisibilité commerciale : un prospect qui lirait une réponse mentionnant Criteo en troisième ou quatrième position après deux concurrents américains retiendrait probablement ces derniers.

La troisième catégorie, celle des déclassés modérés, regroupe les entreprises dont l'IDA est important mais qui réussissent néanmoins à être cités en première position de façon non négligeable : Saint-Gobain (33 points), Publicis (33 points), Dataiku (21 points), Ubisoft (10 points). Ces acteurs maintiennent une présence honorable en termes de taux de mention global, mais leur position de citation ne reflète pas leur leadership sectoriel. Saint-Gobain, leader mondial des matériaux de construction, devrait théoriquement être cité en premier dans 33% des requêtes relatives à son marché : il ne l'est que dans 22,73% des cas en français et 9,52% en anglais, révélant que les modèles le perçoivent comme un acteur parmi d'autres plutôt que comme le leader incontesté qu'il est objectivement.

L'enseignement majeur de l'analyse IDA tient en une formule : dans l'économie de l'IA, être présent ne suffit plus, il faut être recommandé en priorité. Or cette priorité algorithmique ne découle pas mécaniquement de la part de marché réelle. Elle résulte de l'autorité narrative que l'entreprise a su construire dans les corpus sources des modèles. Les surperformants comme Decathlon, Veolia ou Qonto partagent un point commun : une stratégie de contenu extensive, une documentation publique abondante, une présence médiatique soutenue qui ont saturé l'internet ouvert de signaux d'autorité. À l'inverse, les déclassés critiques comme Criteo ou Worldline ont probablement négligé cette dimension, privilégiant la communication commerciale fermée au détriment de la construction d'une empreinte sémantique publique. Le déclassement algorithmique n'est donc pas une fatalité technique mais le symptôme d'un déficit stratégique d'investissement dans la visibilité narrative.

1.4. le biais de ghettoïsation linguistique : frein à l'internationalisation

Au-delà de la fracture sectorielle, notre étude révèle l'existence d'un phénomène que nous qualifions de "ghettoïsation linguistique" : une discrimination algorithmique fondée sur la langue dans laquelle la requête est formulée. Pour chaque entreprise de notre échantillon, nous avons soumis des prompts strictement équivalents en français et en anglais aux trois modèles testés. L'analyse comparative fait apparaître un biais systématique, certes modéré en valeur absolue mais stratégiquement déterminant.

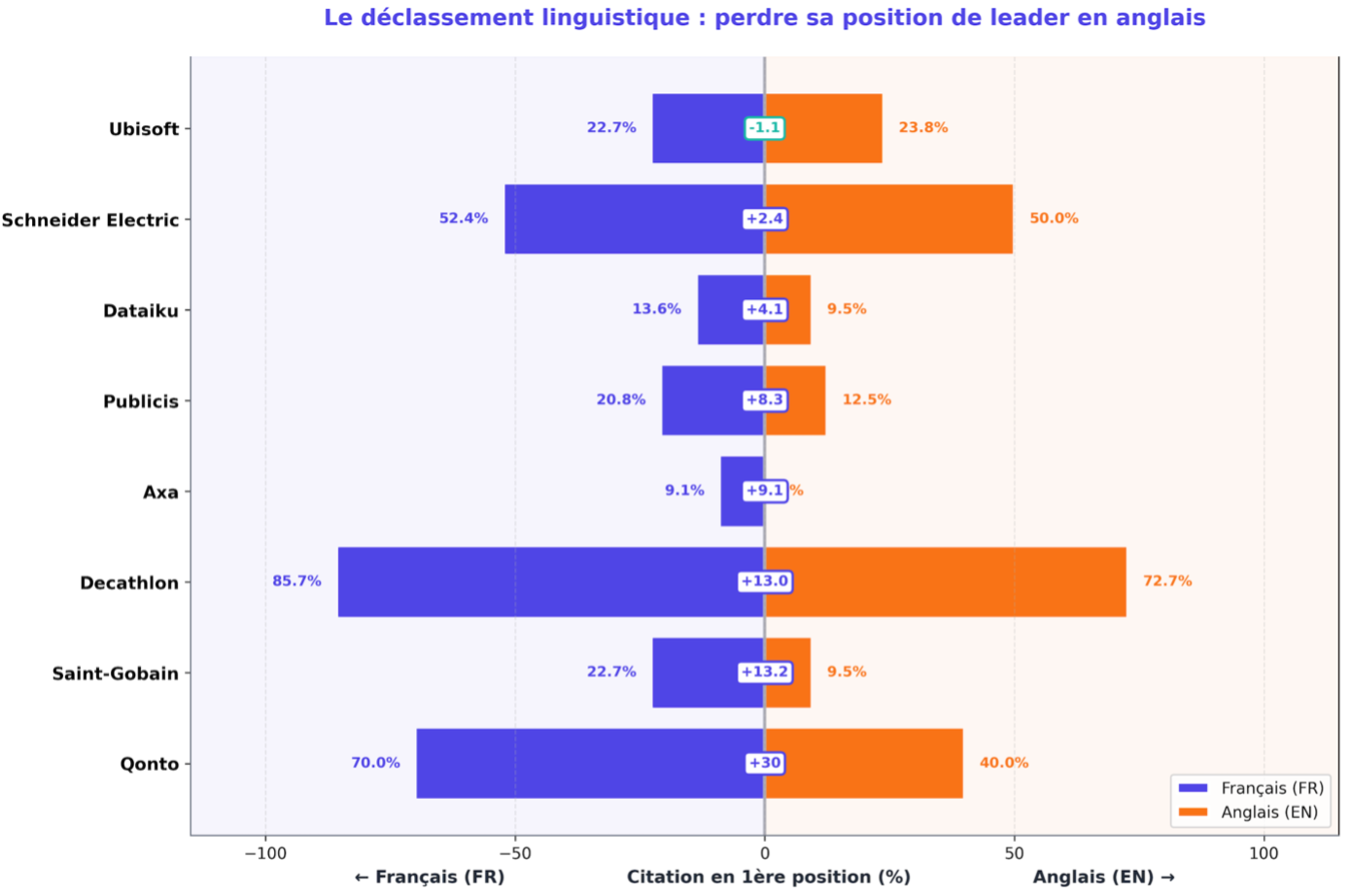

Sur l'ensemble du corpus, le taux de mention moyen en français s'établit à 73,20%, contre 72,47% en anglais. Il s’agît d’une différence à première vue négligeable de 0,73 points, mais qui en réalité est significative. Lorsque nous mesurons non plus la simple mention mais la position de citation en rang numéro un dans les réponses générées, l'écart se creuse significativement : 23,49% de citations en première position pour les requêtes en français, contre seulement 19,00% pour les requêtes en anglais. L’Indice de déclassement artificiel (IDA) que nous avons conçu permet d’analyser le déclassement subit par les marques françaises par rapport à leur leadership théorique. Ainsi alors que les entreprises françaises subissent un déclassement IDA de 13 points sur les requêtes en français, celui-ci augmente à 18 points en anglais, soit une augmentation de plus de 35% de l’indice de déclassement artificiel en passant du français à l’anglais.

Cette pénalité de visibilité linguistique n'affecte pas uniformément toutes les entreprises. Certaines d'entre elles connaissent de véritables situations de "ghetto domestique" : Edenred affiche 27,3% de taux de mention dans les requêtes en français, mais tombe à 0% dans les requêtes en anglais. AXA passe de 95,5% en français à 68,2% en anglais, soit une chute de 27 points. Decathlon recule de 22,7 points entre les deux langues. À l'inverse, quelques entreprises bénéficient paradoxalement d'un "bonus de visibilité anglophone" : Thales progresse de 29,4 points en anglais par rapport au français (61,9% contre 91,3%), Sephora gagne 22,7 points, Schneider Electric 19 points.

Sur le plan du déclassement le biais linguistique est également inégal. Des acteurs comme Véolia, Sephora ou Dassault Systèmes font preuve d'une remarquable immunité au biais linguistique sur le plan du déclassement : Véolia maintient une position de leadership quasi-identique avec 80,95% de citations en première position en français contre 80% en anglais (écart de 0,95 point), Sephora affiche une stabilité parfaite à 72,73% dans les deux langues, et Dassault Systèmes conserve exactement le même taux de 9,09% quelle que soit la langue de requête sur les prompts testés. Ces entreprises, souvent multinationales historiques ayant investi massivement dans une documentation technique bilingue de qualité équivalente, démontrent qu'une stratégie de contenu véritablement internationale neutralise la pénalité linguistique.

En revanche, d'autres acteurs subissent un déclassement sévère en position de leader malgré une mention correcte : Qonto, bien que maintenant un taux de mention de 100% dans les deux langues, voit son taux de citation en première position s'effondrer de 70% en français à 40% en anglais, perdant ainsi 30 points de leadership. Decathlon, pourtant cité systématiquement, recule de 85,71% à 72,73% en position #1 entre français et anglais. Saint-Gobain passe de 22,73% à 9,52%, soit une division par 2,4 de son leadership algorithmique. Ces entreprises illustrent un phénomène insidieux : être présent ne suffit pas, encore faut-il être recommandé en priorité, et cette priorité s'érode massivement lorsque la requête est formulée en anglais, ce qui entrave la construction d’un leadership international.

L'interprétation de ces données nécessite de dépasser les explications simplistes. Il ne s'agit pas d'un biais anti-français programmé dans les algorithmes, la présence du « bonus anglophone » pour certaines entreprises ou d’une « neutralité linguistique » pour d'autres infirme cette hypothèse. Le mécanisme à l'œuvre est plus subtil : les modèles de langage reflètent la distribution du contenu disponible dans leurs corpus d'entraînement et en ligne. Or ces corpus, dominés par l'internet anglophone (estimé à 60% du contenu web total contre moins de 5% pour le français selon W3Techs), surreprésentent mécaniquement les sources anglophones. Les entreprises françaises dont la documentation d'autorité (études de cas détaillées, livres blancs techniques, tribunes d'expert dans les médias de référence, etc.) n'existe qu'en français, ou dont les versions anglaises sont pauvres, mal référencées, ou confinées à des espaces payants, se trouvent de facto pénalisées en position de leadership lorsqu'un utilisateur international formule sa requête en anglais.

Le cas particulier de Qonto illustre parfaitement cet enjeu : avec un taux de mention identique de 100% en français et en anglais, cette néobanque démontre qu'une stratégie de contenu véritablement bilingue neutralise le handicap linguistique. Mais son taux de citation en première position chute de 70% en français à 40% en anglais, révélant que même une visibilité quantitative identique ne garantit pas un positionnement qualitatif équivalent. Pour les entreprises françaises aspirant à une croissance internationale, cette ghettoïsation linguistique constitue un frein direct : alors que 46% des décideurs B2B déclarent utiliser ChatGPT ou un équivalent pour leurs recherches de solutions (The Insight Collective, B2B Tech Buyer Behavior, 2025), être invisible dans les réponses en anglais revient à s'exclure volontairement des marchés internationaux.

1.5. La loterie algorithmique : l'illusion de l'objectivité

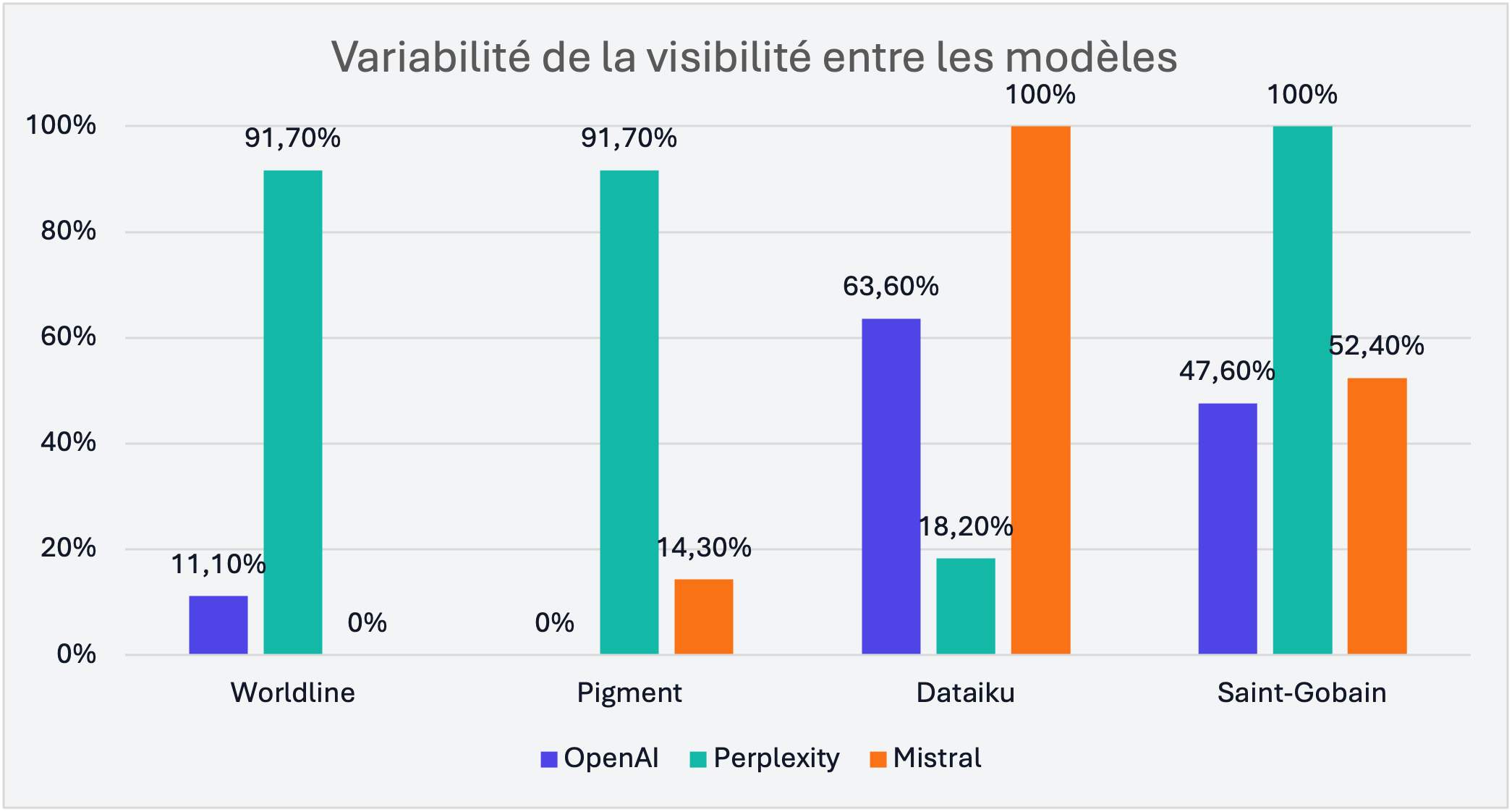

Un dernier enseignement de notre étude invalide l'idée selon laquelle les modèles de langage produiraient des recommandations objectives et convergentes. L'analyse des variations de performance d'une même entreprise selon le modèle interrogé révèle au contraire une forme de "loterie algorithmique" : des écarts de visibilité pouvant atteindre 91,7 points de pourcentage selon que la requête est adressée à OpenAI, Perplexity ou Mistral.

Worldline en constitue l'exemple paradigmatique : cette entreprise affiche un taux de mention de 91,7% lorsque Perplexity AI répond à la requête, mais tombe à 0% lorsque la même requête est soumise à Mistral. Pigment connaît une volatilité identique, passant de 91,7% sur Perplexity à 0% sur OpenAI. Dataiku oscille entre 100% de visibilité sur Mistral et 18,2% sur Perplexity. Ces variations extrêmes ne peuvent s'expliquer par des différences de légitimité ou de pertinence (les entreprises concernées sont objectivement des leaders sur le segment testé) mais bien par l'hétérogénéité des corpus sources et des mécanismes de retrieval de chaque modèle.

Cette fragmentation crée une incertitude stratégique inédite : là où une entreprise pouvait autrefois optimiser sa présence pour un moteur de recherche dominant (Google captant 92% du marché européen), elle doit désormais gérer une multiplicité de canaux conversationnels dont les logiques d'indexation divergent radicalement. Le risque est double : d'une part, l'impossibilité de prédire quel modèle sera utilisé par un prospect donné rend toute stratégie d'optimisation partielle potentiellement contre-productive ; d'autre part, la cristallisation rapide des préférences utilisateurs risque de créer des effets de lock-in, où les entreprises absentes des réponses d'un modèle en phase de montée en puissance se trouvent durablement exclues de sa base d'utilisateurs.

Les trois modèles testés présentent d'ailleurs des profils de citation distincts : OpenAI affiche le taux de mention global le plus élevé (75,03%) et cite fréquemment les entreprises en première position (26,53%), ce qui suggère un corpus large et une logique de citation multiple. Perplexity, bien que moins généreux en taux de mention global (69,52%), se distingue par une stratégie de diversification extrême : son taux de citation en première position tombe à 2,50%, révélant une tendance à proposer systématiquement plusieurs alternatives plutôt qu'un leader unique. Mistral, enfin, occupe une position intermédiaire (72,14% de mention globale) mais s'avère le plus généreux en citations de premier rang (27,86%), peut-être par volonté de trancher plus nettement entre les options.

Ces profils divergents interdisent toute stratégie monocanal. L'optimisation pour l'un des modèles ne garantit nullement la visibilité sur les autres. Cette fragmentation algorithmique, si elle n'est pas rapidement maîtrisée par les entreprises françaises, risque d'accentuer encore leur retard : pendant qu'elles découvrent l'existence du problème, leurs concurrents américains -dont la présence massive dans les corpus anglophones assure une visibilité de base sur tous les modèles- accumulent déjà un avantage comparatif difficile à rattraper.

2. De l'invisibilité au manque à gagner : comment l'IA va coûter 6 milliards d'euros par aux champions français

2.1. De l'invisibilité au manque à gagner : une extrapolation nécessaire

Quantifier l'impact économique de l'invisibilité algorithmique nécessite de projeter la migration du trafic commercial des moteurs de recherche traditionnels vers les interfaces conversationnelles d'IA. Les données de trafic consolidées sur le dernier trimestre 2025 indiquent qu’environ 10% des recherches s'effectuent désormais via des LLM plutôt que via Google. Cette proportion, encore marginale, connaît une croissance exponentielle : selon les projections moyennes agrégées de Gartner, elle atteindra 30% en 2026, et franchirait la barre des 50% avant 2028.

Pour modéliser l'impact de cette transition, nous avons construit une méthodologie en trois étapes. Premièrement, nous avons estimé la part du chiffre d'affaires de chaque entreprise générée via l'acquisition digitale : proportion variant selon le secteur entre 30% (industrie lourde) et 60% (pure players B2B tech). Deuxièmement, nous avons appliqué le taux de migration vers les LLM à cette part digitale : en 2026, avec 30% de migration, cela signifie que 30% × part_digitale du CA transite désormais par les canaux conversationnels. Troisièmement, nous avons multiplié ce flux par l'IIA de chaque entreprise : si Criteo est invisible dans 97,73% des réponses, il perd mécaniquement 97,73% des prospects empruntant ce canal.

Sur cette base, et en retenant le scénario médian (30% de migration en 2026, part digitale sectorielle moyenne), le manque à gagner collectif des vingt entreprises analysées s'élèverait à 5,99 milliards d'euros en 2026. AXA, compte tenu de son chiffre d'affaires massif (102 milliards d'euros) et de son IIA modéré mais non négligeable (18,2%), concentre à elle seule 1,95 milliard d'euros de perte potentielle. Saint-Gobain, malgré un IIA contenu à 34,9%, voit son manque à gagner atteindre 1,50 milliard d'euros du fait de son CA de 47,9 milliards. Worldline, avec un IIA catastrophique de 70,5% mais un CA plus modeste de 4,6 milliards, perd 583 millions d'euros. Criteo, le cas le plus critique, enregistre un manque à gagner de 334 millions d'euros : soit 17,6% de son chiffre d'affaires total.

Cette extrapolation repose sur une hypothèse forte : la proportionnalité entre invisibilité algorithmique et perte de prospects. Cette hypothèse est discutable, un prospect particulièrement motivé pourra compenser l'absence de recommandation IA par une recherche active, mais elle n'en demeure pas moins conservatrice. D'une part, elle ne tient pas compte de l'effet de déclassement (IDA) : une entreprise citée en quatrième position dans une réponse de ChatGPT capte vraisemblablement moins de leads que si elle apparaissait en premier, mais notre modèle traite ces deux situations comme équivalentes. D'autre part, elle ignore l'effet de cristallisation des préférences : plus un modèle recommande systématiquement un acteur A plutôt qu'un acteur B, plus la notoriété relative de A augmente, ce qui renforce sa probabilité d'être recommandé lors des itérations suivantes, créant une dynamique d’effet « boule de neige » que notre modèle linéaire ne capture pas.

Si l'on prolonge l'exercice à l'horizon 2028 avec un taux de migration porté à 50%, le manque à gagner collectif atteint 9,99 milliards d'euros. Sur la période cumulée 2024-2026, en tenant compte de la progression graduelle du phénomène, l'impact total avoisine 18,9 milliards d'euros. Ces ordres de grandeur, même assortis d'une marge d'incertitude substantielle, suffisent à qualifier l'invisibilité algorithmique non comme un désagrément marketing mais comme un risque stratégique de premier plan.

2.2. Le surcoût marketing défensif : compenser l'organique par le payant

Au-delà du manque à gagner direct en termes de leads perdus, l'invisibilité dans les réponses d'IA génère un second effet économique : l'obligation d'investir davantage en publicité payante (search engine advertising, display, social ads) pour compenser la perte de visibilité organique. Dans l'économie du search traditionnel, une entreprise bien référencée naturellement pouvait limiter ses dépenses SEA aux mots-clés les plus compétitifs. Dans l'économie conversationnelle, une entreprise systématiquement absente des réponses génératives devra acheter la quasi-intégralité de son trafic.

Ce surcoût présente une caractéristique particulière : le surcoût marketing constitue une rente versée aux plateformes publicitaires (Google Ads, Meta, LinkedIn, demain les entreprises de LLM si elles proposent ce service) qui ne peut être évitée qu'en résolvant le problème à la racine, c'est-à-dire en optimisant la présence dans les corpus sources des LLM. Autrement dit, l'invisibilité algorithmique crée une dépendance structurelle aux canaux payants, transférant durablement de la valeur des entreprises productrices vers les intermédiaires publicitaires.

2.3. L'asymétrie compétitive France - Etats-Unis : la rente de l'hégémonie linguistique

L'analyse économique serait incomplète si elle n'intégrait pas la dimension géostratégique de l'invisibilité française. Bien que notre étude n'ait pas inclus de groupe de contrôle composé d'entreprises américaines (limite méthodologique que nous reconnaissons), plusieurs indicateurs convergents suggèrent l'existence d'une asymétrie structurelle défavorable aux acteurs français.

Premièrement, la surreprésentation de l'anglais dans les corpus d'entraînement des LLM (60% contre <5% pour le français) confère mécaniquement un avantage de visibilité de base aux entreprises produisant nativement du contenu en anglais. Deuxièmement, les modèles dominants (OpenAI, Anthropic, Gemini) sont développés par des entreprises américaines dont les équipes d'entraînement, les testeurs, et les early adopters évoluent majoritairement dans l'écosystème anglo-saxon, créant des biais d'échantillonnage même involontaires. Troisièmement, les partenariats de données privilégiés noués par ces acteurs (Reddit pour OpenAI, Stack Overflow pour divers modèles, médias américains) renforcent encore la surreprésentation du contenu US.

Cette asymétrie transforme l'hégémonie linguistique en rente économique. Pendant que Criteo, leader mondial de la publicité programmatique, doit investir massivement pour tenter d'apparaître dans les réponses de ChatGPT, ses concurrents américains moins dominants sur le plan technique bénéficient d'une visibilité algorithmique de fait supérieure du simple fait de leur environnement linguistique et éditorial. Le "discount de visibilité" subi par les entreprises françaises n'est donc pas seulement un problème d'optimisation technique, c'est un désavantage compétitif qui érode progressivement leurs parts de marché à l'international, précisément au moment où la stratégie nationale mise sur leur expansion hors de France.

Le risque, à terme, est celui d'un décrochage structurel : si les positions dans les réponses d'IA se cristallisent rapidement (effet "boule de neige" évoqué précédemment), et si les entreprises françaises accusent un retard de plusieurs années dans la prise de conscience et la mise en œuvre de stratégies AEO / GEO, elles pourraient se trouver durablement confinées à leurs marchés domestiques ou régionaux, pendant que leurs concurrents américains et chinois captent l'essentiel de la croissance mondiale via leur visibilité algorithmique supérieure. L'invisibilité dans l'IA ne serait plus alors un simple problème marketing, mais un facteur structurant de la géo-économie du XXIe siècle.

3. Pourquoi les LLM ne citent pas les entreprises françaises ?

3.1. L'écart d'infrastructures sémantiques : Knowledge Graphs versus documentation PDF

La première cause structurelle de l'invisibilité française tient à l'écart d'infrastructure sémantique séparant les écosystèmes numériques américain et français. Depuis le milieu des années 2010, les grandes entreprises technologiques américaines ont massivement investi dans la construction de Knowledge Graphs : bases de données structurées décrivant les entités, leurs attributs, et leurs relations sous une forme directement exploitable par les algorithmes. Google Knowledge Graph, lancé en 2012, recense aujourd'hui plus de 500 milliards de faits structurés, et Microsoft, Amazon, Facebook ont développé leurs propres graphes sémantiques sectoriels. Ces infrastructures servent de squelette aux modèles de langage : lorsqu'un LLM répond à une question factuelle, il ne se contente pas de "deviner" statistiquement la suite de mots probable, il effectue souvent un retrieval dans ces graphes ou données structurées pour ancrer sa réponse dans des faits vérifiés.

À l'inverse, les entreprises françaises, y compris les champions du CAC40, ont historiquement privilégié une logique de documentation fermée. Leurs informations stratégiques sont consignées dans des rapports annuels PDF (difficilement indexables), des sites institutionnels en Flash ou JavaScript difficilement lus par les robots d’indexation, des communiqués de presse hébergés sur des plateformes propriétaires, voire des intranets entièrement fermés au public. Cette culture de la confidentialité, héritée d'une époque où l'information était un actif stratégique à protéger, se retourne aujourd'hui contre ces entreprises : ce qui n'est pas structuré et accessible publiquement n'existe tout simplement pas pour les modèles de langage. Il ne s’agit pas pour les champions européens de construire leurs propres Knowledge Graphs mais d’adopter une logique de documentation ouverte afin d’être mieux représenté dans les Knowledge Graphs des géants américains.

Le cas de Criteo illustre parfaitement ce paradoxe. Cette entreprise dispose d'une documentation technique exhaustive, mais majoritairement confinée à des portails clients authentifiés, des webinaires privés, et des whitepapers téléchargeables uniquement après saisie d'un formulaire commercial. A l’inverse ses concurrents américains comme The Trade Desk, plus transparents dans leur communication saturent l'internet ouvert de cas d'usage, tribunes d'experts, et contenus éducatifs librement accessibles. Ainsi, Criteo demeure invisible aux yeux des crawlers qui alimentent les corpus d'entraînement.

3.2. La culture de la documentation : transparance américaine vs discrétion française

Au-delà de l'infrastructure, c'est une différence culturelle profonde qui explique l'écart de visibilité. La culture d'entreprise anglo-saxonne, portée principalement par les États-Unis et le Royaume-Uni, valorise la transparence documentaire comme outil de légitimation et de recrutement : publier exhaustivement sa méthodologie, partager ses métriques de performance (y compris les échecs), documenter publiquement son architecture technique relève non du risque mais de la stratégie de marque. Les tech companies de la Silicon Valley ont porté cette logique à son paroxysme avec la doctrine du "default to open" : sauf exception justifiée, toute information est publique par défaut.

Cette culture a produit un internet anglophone extrêmement dense en documentation technique de qualité : Stack Overflow compte 23 millions de questions-réponses en anglais contre 400 000 en français ; GitHub héberge 85% de ses repositories en anglais ; les forums spécialisés, les chaînes YouTube tutorielles, les podcasts d'expertise sont massivement anglophones. Cette asymétrie dépasse largement le simple effet démographique : si l'on ajuste pour la taille des populations B2B tech (environ 1,5 milliard de professionnels anglophones contre 100 millions de francophones, soit un ratio de 15×), le ratio observé sur Stack Overflow (57,5×) révèle une surreprésentation du contenu anglophone d'un facteur 3,8 , indiquant non seulement un avantage de volume, mais une différence qualitative de pratiques documentaires. Les entreprises évoluant dans l'écosystème anglophone produisent ainsi, à population égale, substantiellement plus de contenu technique accessible publiquement que leurs homologues francophones.

Cette densité crée un cercle vertueux pour les entreprises anglophones (et particulièrement américaines) : plus elles documentent, plus elles sont visibles dans les recherches, plus elles attirent de talents et de clients, plus elles documentent. À l'inverse, la culture française de l'entreprise valorise la discrétion, la maîtrise de l'information, et une certaine forme de mystère stratégique. Publier en détail ses processus internes, ses difficultés opérationnelles, ou ses arbitrages technologiques est perçu comme une vulnérabilité plutôt qu'un atout. Cette différence culturelle n'est ni bonne ni mauvaise en soi, elle reflète des traditions managériales distinctes, mais elle devient pénalisante dans un monde où la visibilité algorithmique repose précisément sur la densité du contenu public accessible.

Cette logique est confirmée par les entreprises françaises les plus visibles dans notre étude (Decathlon, Veolia, Air Liquide), qui sont précisément celles qui ont, depuis des années, adopté des stratégies de contenu proches des standards anglo-saxons : blogs corporate actifs, chaînes YouTube institutionnelles, présence sur LinkedIn, documentation technique en libre accès. À l'inverse, les plus invisibles (Criteo, Worldline) ont plutôt eu des stratégies de communication fermées, orientées vers la relation commerciale directe plutôt que vers la diffusion large : stratégies qui fonctionnaient dans l'économie du search traditionnel mais qui les condamnent à l'invisibilité dans l'économie des modèles génératifs.

3.3. Le retard d'investissement : SEO acquis, GEO inexistant

La troisième cause du retard français tient au décalage temporel entre l'émergence d'un problème et sa prise en charge stratégique. Dans le domaine du Search Engine Optimization (SEO), les entreprises françaises ont accusé un retard initial de trois à cinq ans sur leurs homologues américaines dans les années 2000, avant de rattraper leur retard au cours de la décennie 2010. Aujourd'hui, la plupart des champions français disposent d'équipes SEO matures, de consultants spécialisés, et de budgets dédiés à l'optimisation pour Google.

Mais le Generative Engine Optimization (GEO) ou Answer Engine Optimization (AEO), discipline sœur visant à optimiser la présence dans les réponses des LLM, en est encore au stade embryonnaire en France. Alors que des acteurs spécialisés émergent aux États-Unis depuis 2023 et que certaines entreprises américaines ont déjà internalisé des "Head of AI Visibility", l'écosystème français demeure largement inconscient du problème.

Ce retard d'investissement n'est pas irrémédiable, il reflète simplement le caractère récent de la disruption, mais il se creuse de façon croissante. Chaque mois qui passe sans optimisation renforce les positions des concurrents déjà visibles (effet "boule de neige"), rend plus coûteuse la remontée algorithmique (saturation des corpus sources), et accroît le gap de compétences entre équipes américaines déjà formées et équipes françaises encore à former. Le risque est qu'au moment où la prise de conscience s'opérera, le retard soit devenu structurellement infranchissable, comme ce fut le cas pour certaines entreprises européennes qui, ayant négligé le SEO jusqu'aux années 2015, n'ont jamais pu rattraper leur retard sur des requêtes stratégiques saturées par des concurrents américains depuis quinze ans.

3.4. Une fatalité ? Non, un problème d'infrastructure réversible

Il serait tentant de conclure que l'invisibilité française dans l'économie de l'IA constitue une fatalité technologique ou culturelle. Cette conclusion serait erronée. Notre étude démontre au contraire que les entreprises françaises peuvent atteindre une visibilité optimale : six d'entre elles affichent un taux de mention de 100%, prouvant qu'aucun plafond de verre systémique ne limite les acteurs français. La différence entre Accor (100% de visibilité) et Worldline (29,55%) ne tient ni à leur nationalité, ni à leur taille, ni à leur légitimité sectorielle : elle tient à leur stratégie de contenu numérique.

De même, le "bonus anglophone" dont bénéficient certaines entreprises françaises (Thales, Schneider Electric, Sephora) lorsqu'elles sont interrogées en anglais invalide l'hypothèse d'un biais anti-français programmé. Ces entreprises ne sont pas devenues anglo-saxonnes, elles ont simplement investi dans la production de contenu anglophone ou adapté aux indexations en anglais de qualité, correctement structuré et largement diffusé.

L'invisibilité française n'est donc ni une fatalité linguistique, ni un déterminisme culturel, ni un handicap technique insurmontable. C'est un problème d'infrastructure numérique réversible, à condition d'en reconnaître l'existence, d'en comprendre les mécanismes, et d'y allouer les ressources appropriées. La section suivante présente les voies de résolution.

4. Le Generative Engine Optimization (GEO) : traduire l'excellance française en visibilité algorithmique

4.1. Définition et périmètre du Generative Engine Optimization

Le Generative Engine Optimization (GEO), parfois aussi appelé Answer Engine Optimiztion (AEO), désigne l'ensemble des techniques visant à optimiser la présence d'une entité (entreprise, produit, personnalité) dans les réponses générées par les Large Language Models (LLM). Contrairement au SEO, qui cible les pages de résultats des moteurs de recherche (SERP), le GEO cible les réponses synthétiques produites par les modèles conversationnels. Cette différence de cible implique une différence de méthode.

Le SEO repose sur trois piliers : l'optimisation technique du site (vitesse, crawlabilité, indexation), l'optimisation du contenu (mots-clés, structure sémantique, fraîcheur), et l'optimisation de l'autorité (backlinks, citations, réputation). Le GEO conserve ces trois dimensions mais les transpose dans un nouveau paradigme. L'optimisation technique devient structuration sémantique : il ne s'agit plus de faciliter le crawl d'un robot, mais de produire des données directement ingérables par les modèles, via des formats structurés (JSON-LD, Schema.org, Knowledge Graphs propriétaires). L'optimisation du contenu devient autorité narrative : il faut non plus placer des mots-clés, mais construire des récits factuels cohérents, densément sourcés, qui s'imposent comme référence dans le domaine. L'optimisation de l'autorité devient validation par consensus ou autorité prioritaire : les modèles privilégient les sources citées par de multiples acteurs indépendants, créant un système de réputation décentralisé, ou des sources identifiés comme ayant un très haut facteur d’autorité.

Concrètement, une stratégie GEO pour une entreprise comme Worldline impliquerait cinq chantiers simultanés. Premièrement, la structuration de ses données clés dans des formats sémantiques standards accessibles publiquement. Deuxièmement, la production de contenu éducatif de haute qualité (guides techniques, livres blancs, études de cas) diffusés en open access plutôt que derrière des formulaires. Troisièmement, la multiplication de tribunes d'experts dans des médias tiers pour créer des citations externes indépendantes très qualitative. Quatrièmement, l'optimisation linguistique : version anglaise systématique et de qualité équivalente à la version française pour tout contenu stratégique. Cinquièmement, le monitoring continu de la performance via des outils spécialisés mesurant le taux de citation dans les principales plateformes conversationnelles.

4.2. Urgence stratégique : la fenêtre de tir se ferme

L'argument décisif en faveur d'une mobilisation immédiate des entreprises françaises sur le GEO tient au caractère temporaire de la fenêtre d'opportunité actuelle. Nous sommes aujourd'hui dans une phase transitoire, que nous estimons durer de dix-huit à trente-six mois, où les positions algorithmiques ne sont pas encore cristallisées et facilement accessibles. Les modèles de langage continuent d'être réentraînés fréquemment (tous les trois à six mois pour les versions majeures), leurs corpus sources évoluent, et les utilisateurs eux-mêmes n'ont pas encore stabilisé leurs préférences de modèle. C'est dans cette période de fluidité qu'il est encore possible de modifier significativement sa visibilité.

Mais cette fenêtre se referme. Plusieurs mécanismes de verrouillage sont à l'œuvre. Le premier est l'effet de renforcement algorithmique : plus un acteur est cité, plus il accumule de nouveaux contenus qui mentionnent cette citation (articles de presse, études de marché, forums), ce qui augmente encore sa probabilité d'être cité lors du prochain entraînement du modèle. Le second est l'effet de saturation des corpus : à mesure que les sources publiques de qualité se raréfient (tout ayant déjà été indexé), les modèles accordent un poids croissant aux sources historiquement établies, rendant plus difficile l'émergence de nouveaux acteurs. Le troisième est l'effet de cristallisation des préférences utilisateurs : une fois qu'un décideur B2B a internalisé que "pour le paiement, ChatGPT recommande toujours Stripe", il cessera de poser la question et se dirigera directement vers Stripe — même si Worldline a, entre-temps, amélioré sa visibilité.

Ces trois mécanismes créent un risque de path dependency : les positions acquises dans les deux prochaines années pourraient déterminer durablement la hiérarchie compétitive de la décennie 2030. Les entreprises qui investissent aujourd'hui dans le GEO bénéficieront d'un avantage de premier entrant difficile à rattraper. Celles qui tardent risquent de se trouver structurellement exclues. L'histoire du SEO offre un précédent instructif : les entreprises qui ont investi massivement dans le référencement Google entre 2005 et 2010 continuent, quinze ans plus tard, de bénéficier de positions dominantes sur des requêtes stratégiques, simplement parce qu'elles ont accumulé un capital d'autorité (backlinks, ancienneté de domaine, densité de contenu) infranchissable pour des entrants tardifs.

L'urgence n'est donc pas marketing mais stratégique. Il ne s'agit pas de capter quelques leads supplémentaires, mais de préserver la capacité même de l'entreprise à être découverte par les générations futures de clients. Dans un monde où les recherches LLM dépasseront en volumes les recherches Google d’ici 2 à 5 ans, l'invisibilité algorithmique équivaut progressivement à l'invisibilité tout court. Les entreprises françaises qui ne corrigeront pas leur déficit de visibilité d'ici là risquent de devenir structurellement inaccessibles aux nouvelles générations d'acheteurs condamnant, à terme, leur modèle économique.

Le rôle de Nodiris : traduire l'excellence en visibilité algorithmique

C'est précisément ce besoin stratégique de visibilité dans les IA qu'Nodiris souhaite résoudre. En tant qu’acteur spécialisé en Generative Engine Optimization, notre mission consiste à rendre aux marques leur visibilité et faire des IA leur nouveau canal d’acquisition. Les entreprises françaises ne souffrent pas d'un déficit de compétences techniques ou d'innovation, mais d'un déficit de traduction sémantique de ces compétences vers les formats et canaux privilégiés par les modèles de langage. Un investissement rapide des entreprises françaises dans le GEO leur permettrait de corriger leur déficit de visibilité IA.

La fenêtre d'action est étroite mais encore ouverte. Les entreprises qui ne corrigeront pas leur déficit de visibilité d’ici 2 à 5 ans risquent de devenir structurellement inaccessibles aux nouvelles générations d'acheteurs, condamnant à terme leur capacité à capter de nouveaux clients sur les marchés internationaux. Ce n'est pas une question de quelques leads perdus, mais de préservation de la capacité même de l'entreprise à être découverte par les générations futures de prospects.

Ensuite, lorsque les positions algorithmiques se seront cristallisées, les budgets publicitaires compensatoires seront devenus permanents. Et les 6 milliards d'euros de manque à gagner estimés pour 2026 se seront transformés en 10 milliards en 2028. Investir aujourd’hui dans son GEO / AEO, n’est pas seulement un enjeu marketing mais stratégique.

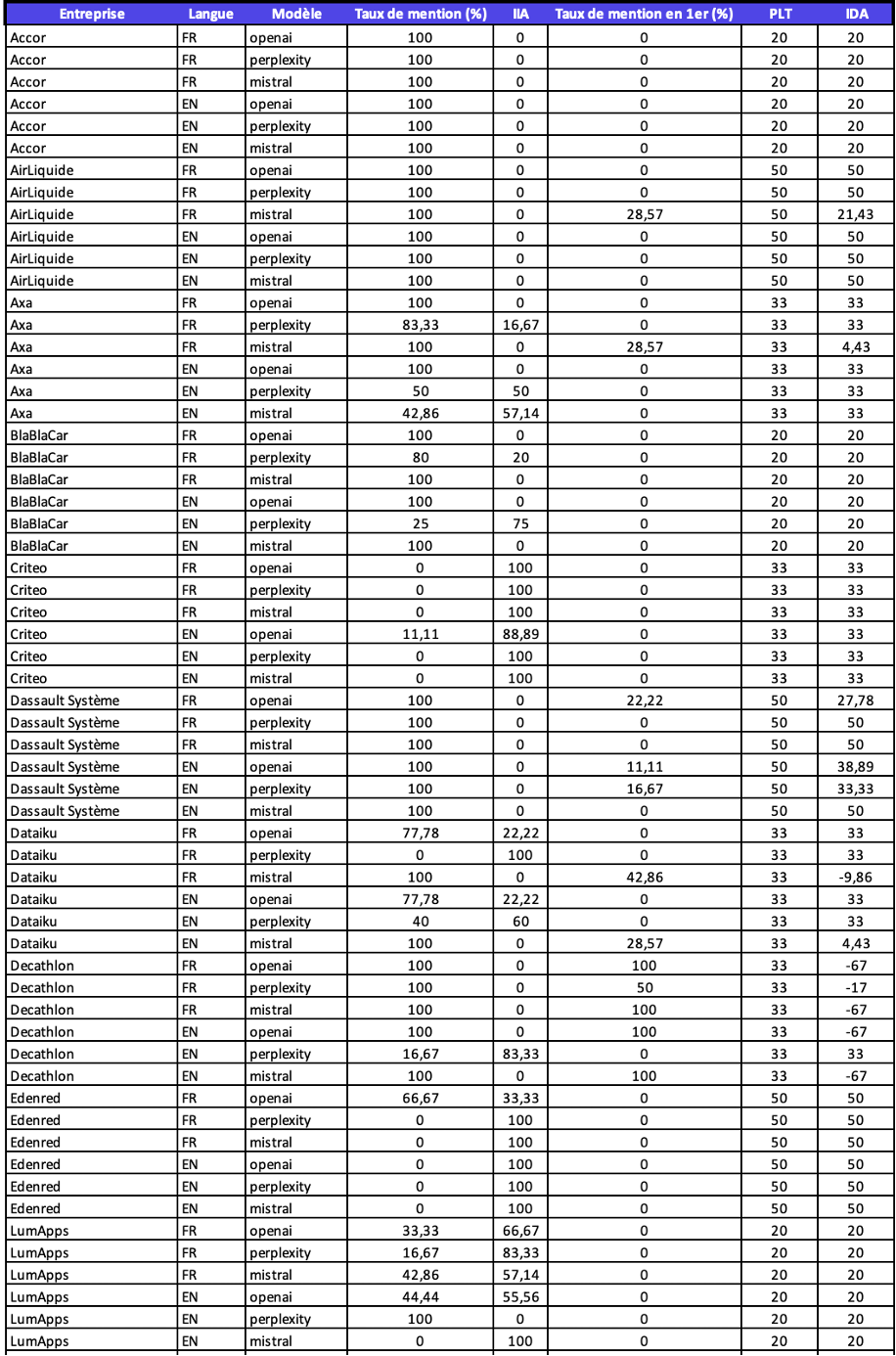

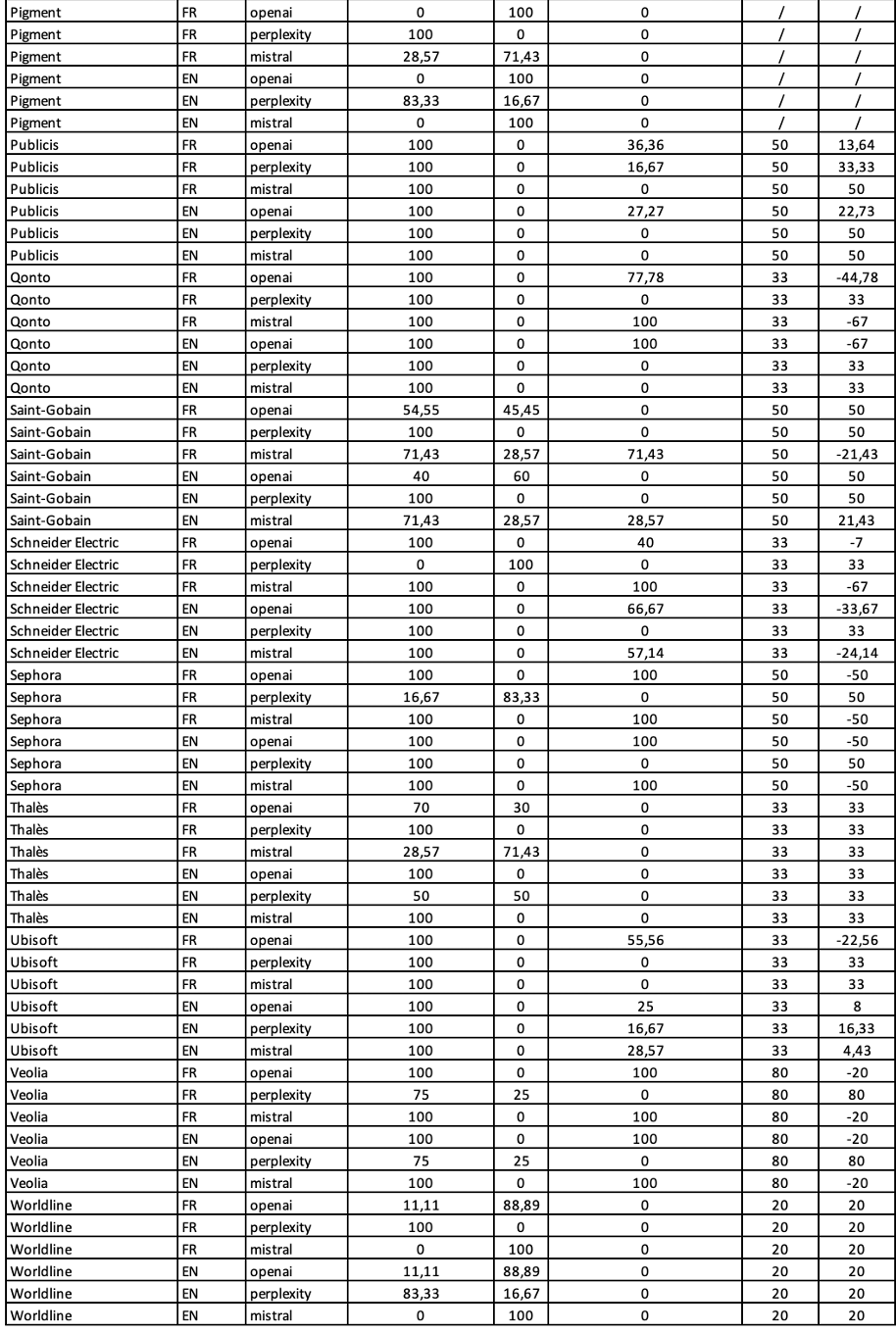

Annexe 1 : Résultats détaillés par entreprise

Annexe 2 : Protocole méthodologique

Période de collecte : Décembre 2025

Corpus de requêtes : 857 prompts commerciaux répartis équitablement entre 20 entreprises (environ 43 requêtes par entreprise), formulés en français et en anglais. Les prompt visent précisément les domaines de domination de entreprises française testées, justifiant qu’elle soit en principe présente dans l’ensemble des réponses.

Secteur 1 : Industrie & Énergie

- Schneider Electric

- EN : List the top 5 companies in energy management and building automation

- FR : Liste les 5 meilleures entreprises en gestion d'énergie et automatisation des bâtiments

- Air Liquide (FR)

- EN : List the top 5 global suppliers of industrial gases and hydrogen

- FR : Liste les 5 principaux fournisseurs mondiaux de gaz industriels et d'hydrogène

- Veolia

- EN : List the top 5 companies in environmental solutions (water, waste, energy)

- FR : Liste les 5 entreprises leaders en solutions environnementales (eau, déchets, énergie)

- Saint-Gobain

- EN : List the top 5 manufacturers of sustainable construction materials

- FR : Liste les 5 meilleurs fabricants de matériaux de construction durables

- Thales

- EN : List the top 5 global defense and aerospace electronics contractors

- FR : Liste les 5 principaux contractants mondiaux en électronique de défense et aérospatial

Secteur 2 : Tech B2B & Logiciels

- Dassault Systèmes

- EN : List the top 5 CAD and PLM software providers for industrial engineering

- FR : Liste les 5 meilleurs logiciels de CAO et PLM pour l'ingénierie industrielle

- Criteo

- EN : List the top 5 advertising platforms for the open internet

- FR : Liste les 5 meilleures plateformes de publicité programmatique pour l'open web

- Dataiku

- EN : List the top 5 enterprise AI platforms for data science collaboration

- FR : Liste les 5 meilleures plateformes d'IA d'entreprise pour la collaboration data

- Pigment

- EN : List the top 5 modern EPM software for financial planning

- FR : Liste les 5 meilleurs logiciels EPM modernes pour la planification financière

- LumApps

- EN : List the top 5 employee experience platforms for internal communication

- FR : List the top 5 employee experience platforms for internal communication

Secteur 3 : Fintech & Services

- Qonto

- EN : List the top 5 online business banking platforms for European SMEs

- FR : Liste les 5 meilleurs comptes pro en ligne pour les PME européennes

- Worldline

- EN : List the top 5 global payment processing partners for enterprise merchants

- FR : Liste les 5 principaux partenaires de traitement des paiements pour les grands commerçants

- Edenred

- EN : List the top 5 global solutions for employee benefits management

- FR : Liste les 5 meilleures solutions mondiales pour les avantages salariés

- Publicis

- EN : List the top 5 global advertising holding companies by revenue

- FR : Liste les 5 plus grands groupes publicitaires mondiaux par revenus

- AXA (FR)

- EN : List the top 5 global insurance providers for multinational corporations

- FR : Liste les 5 meilleurs assureurs mondiaux pour les grandes entreprises

Secteur 4 : Consumer & Retail

- Decathlon

- EN : List the top 5 sporting goods retailers with quality private labels

- FR : Liste les 5 meilleurs distributeurs d'articles de sport avec marques propres

- Sephora

- EN : List the top 5 premium beauty retailers with global presence

- FR : Liste les 5 meilleurs distributeurs de produits de beauté premium à présence mondiale

- Ubisoft

- EN : List the top 5 video game publishers for open-world franchises

- FR : Liste les 5 principaux éditeurs de jeux vidéo pour les mondes ouverts

- Accor

- EN : List the top 5 hotel groups for business travelers in Europe and Asia

- FR : Liste les 5 meilleurs groupes hôteliers pour les voyageurs d'affaires en Europe et Asie

- BlaBlaCar

- EN : List the top 5 cost-effective long-distance travel options in Europe

- FR : Liste les 5 options de voyage longue distance les plus économiques en Europe

Modèles testés :

- OpenAI GPT-5-mini (version décembre 2025)

- Perplexity AI Sonar Reasoning Pro (version décembre 2025)

- Mistral Large Latest (version décembre 2025)

Conditions expérimentales :

- Web search activé pour tous les modèles (accès temps réel)

- Température = 1

- Pas de contexte préalable (chaque requête indépendante)

- Prompts système standardisés encourageant l'exhaustivité

Métriques calculées :

- Taux de mention : Proportion de requêtes où l'entreprise apparaît dans la réponse

- Taux de mention en 1er : Proportion de requêtes où l'entreprise est citée en première position

- IIA (Indice d'Invisibilité Artificielle) : 100% - Taux de mention

- IDA (Indice de Déclassement Artificiel) : PLT - Taux de mention en 1er (où PLT = Part de Leadership Théorique basée sur la structure de marché)

PLT - Part de Leadership Théorique :

Méthode des Paliers de Structure de Marché. Elle consiste à attribuer un score cible en fonction de la physionomie de la concurrence (Duopole, Oligopole, ou Marché Éclaté) et de la précision géographique du prompt.

Voici les 5 paliers utilisés :

- 80% (Leader incontesté) : L’entreprise est un leader incontesté et ne connait pas de concurrent notable similaire.

- 50% (Le Co-Leader / Dominant) : L'entreprise est n°1 ou n°2 incontestable. Elle doit être citée première une fois sur deux.

- 33% (L'Oligopole - Top 3) : L'entreprise fait partie du "Big 3" ou "Big 4" mondial. Elle doit être première une fois sur trois.

- 20% (Marché Compétitif - Top 5) : Le secteur compte de nombreux acteurs majeurs, ou l'entreprise est un leader régional face aux géants US.

- N/A (Focus Invisibilité) : Pour les challengers, calculer un rang n°1 n'a pas de sens statistique. On se concentre uniquement sur leur présence (IIA).

Groupe 1 : Leader sans concurrent notable (Cible PLT : 80%)

| Entreprise | Justification du PLT 80% |

|---|---|

| Veolia | Depuis le rachat de Suez, Veolia est le "Super-Leader" mondial des services à l'environnement, loin devant Waste Management (très US). |

Groupe 2 : Les Dominants & Co-Leaders (Cible PLT : 50%)

L'attente est forte : ils sont des géants mondiaux, souvent plus gros que leurs concurrents US.

| Entreprise | Justification du PLT 50% |

|---|---|

| Air Liquide | Marché quasi-duopolistique avec Linde. Air Liquide est historiquement et financièrement le co-leader absolu. |

| Dassault Systèmes | Sur le segment spécifique "Industrial Engineering", CATIA/Solidworks sont les standards mondiaux face à Autodesk/Siemens. |

| Edenred | Leader mondial incontesté des titres de services prépayés. WEX est un gros concurrent mais sur un scope différent. |

| Publicis | Avec une capitalisation ayant dépassé celle d'Omnicom et WPP, Publicis est techniquement devenu le n°1 ou n°2 du secteur. |

| Saint-Gobain | Aucun acteur US n'a la largeur de gamme et l'empreinte mondiale de Saint-Gobain sur les matériaux durables. |

| Sephora | Icône mondiale du retail beauté sélectif. Ulta est gros aux US, mais Sephora domine le "Global Footprint". |

Groupe 3 : L'Oligopole "Top 3" (Cible PLT : 33%)

Ils sont des leaders indiscutables, mais font face à 2 ou 3 concurrents de taille équivalente. Être cité n°1 une fois sur trois est la norme statistique.

| Entreprise | Justification du PLT 33% |

|---|---|

| AXA | 1ère marque mondiale d'assurance (Interbrand), mais en concurrence frontale avec Ping An (Chine) et les géants US (UnitedHealth/MetLife). |

| Criteo | Leader de l'Open Web, mais le prompt "Advertising Platforms" inclut implicitement la concurrence avec The Trade Desk et Google (DSP). |

| Dataiku | Positionné dans le carré des leaders (Gartner) face à Databricks et DataRobot. Une place dans le trio de tête est attendue. |

| Decathlon | Modèle unique de concepteur-distributeur. Leader mondial en volume, mais face à des géants comme Dick's (Retail US) ou Nike (Direct). |

| Qonto | Le prompt précise "European SMEs". En Europe, Qonto est dans le Top 3 des néobanques (avec Revolut Business). |

| Schneider Electric | Co-leader avec Siemens et Honeywell. |

| Thales | Dans le top 3-4 mondial de l'électronique de défense avec Raytheon, Lockheed et BAE Systems. |

| Ubisoft | Un des rares éditeurs capables de sortir des "Open Worlds" AAA régulièrement, face à EA, Take-Two (GTA) et Sony. |

Groupe 4 : Marchés Compétitifs ou Régionaux (Cible PLT : 20%)

Secteurs très bataillés ou fragmentés. Être cité n°1 est une performance, mais on attend surtout d'être dans le Top 5.

| Entreprise | Justification du PLT 20% |

|---|---|

| Accor | Le prompt cible "Europe & Asie". Accor y est très puissant, mais fait face à la force de frappe massive de Marriott, Hilton, IHG et Hyatt. |

| BlaBlaCar | Leader mondial du covoiturage, mais le prompt est "Voyage longue distance économique". Il est en concurrence avec le train, le bus (FlixBus) et l'avion. |

| LumApps | Leader "Intranet", mais fait face au rouleau compresseur Microsoft (SharePoint/Viva) qui est souvent la réponse par défaut de l'IA. |

| Worldline | Marché des paiements très fragmenté (Fiserv, FIS, Adyen, Stripe, PayPal). Être n°1 est dur, mais être dans le Top 5 est impératif. |

Groupe 5 : Le Challenger (Cible PLT : N/A)

Ici, l'objectif est la visibilité (IIA), pas encore la domination (IDA).

| Entreprise | Justification |

|---|---|

| Pigment | Face à Anaplan ou Excel, Pigment est un challenger Calculer un score de déclassement (IDA) serait injuste. |

Limites méthodologiques reconnues : • Pas de groupe de contrôle américain (limite la comparaison France-USA) • Échantillon limité à 20 entreprises (représentativité partielle) • Snapshot temporel (décembre 2025) ne capture pas les évolutions • Requêtes formulées par l'équipe Nodiris (biais potentiel de formulation)

FAQ - Questions sur l'étude

Qu'est-ce que l'invisibilité dans l'IA ou l'invisibilité artificielle ?

L'invisibilité dans l'IA est analysée dans l'étude à travers deux indicateurs : l'Indice d'Invisibilité Artificielle (IIA) et l'Indice de Déclassement Artificiel (IDA). L'IIA mesure la proportion des requêtes où l'entreprise n'apparaît pas dans la réponse, tandis que l'IDA mesure la proportion des requêtes où l'entreprise n'est pas citée en première position par rapport à son leadership naturel. L'étude révèle ainsi que les champion français sont invisibles dans 27,19% des requêtes, et subissent un déclassement moyen de 16 points.

Quel est l'impact financier de l'invisibilité artificielle ?

L'étude conclut que le manque à gagner de l'invisibilité artificielle est de 6 milliards d'euros en 2026 pour les 20 champions du CAC40/Next40 analysés. Ce chiffre correspond à la perte de prospects qui se tournent vers les IA plutôt que les moteurs de recherche et qui ne voient plus ces marques apparaître. Le manque à gagner devrait croître à près de 10Md€ en 2028 lorsque l'IA représentera 50% des recherches sur internet.

Pourquoi les entreprises françaises sont-elles plus invisibles dans l'IA que les entreprises américaines ?

Les entreprises françaises sont plus invisibles dans l'IA que les entreprises américaines en raison d'un déficit de structuration sémantique. Les entreprises françaises ont tendance à garder leur documentation dans des formats fermés (PDF, Intranet) alors que les géants américains pratiquent le "default to open" et saturent le web anglophone de données structurées faciles à lire pour les IA.

Comment une entreprise peut-elle améliorer sa visibilité dans l'IA ?

Les entreprises peuvent améliorer leur visibilité dans l'IA en adoptant une stratégie AEO / GEO précise : structurer ses données publiques, traduire ses contenus stratégiques en anglais (langue dominante des corpus d'IA), produire du contenu d'autorité en accès libre, en s'assurant que ses contenus soient faciles à lire pour les IA et présents sur des sources d'autorités pour les IA.

Une stratégie de contenu pensée pour l'ère de l'IA

Diagnostic initial · Premiers résultats en quelques semaines